A New Method to Generate Data for Training Autonomous Vehicles

2020年6月29日经过卢克·詹姆斯卡内基·梅隆大学(Carnegie Mellon University)的研究人员开发了一种新技术来生成更多数据,可用于更有效地训练自动驾驶汽车跟踪系统。

不用说,自动驾驶汽车(AV)必须能够跟踪行人,动物,自行车和周围其他车辆的移动,以安全有效地从A点到B。被喂养的数据,除其他外,它是受“训练”的,并学会发现并应对这些障碍和危害。

A technique developed by Carnegie Mellon University (CMU) researchers called "scene flow" may be able to deliver improved results by较大数据集上的培训系统。一般而言,用于培训跟踪系统的数据越多,结果就会越好。而且,根据CMU研究人员的说法,他们已经找到了一种方法,可以为此目的解锁自动驾驶数据的“山”。

Scene Flow

大多数AVS根据传感器数据导航光检测和雷达(LIDAR)扫描环境以生成车辆周围世界的三维信息的系统。

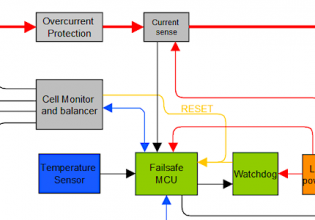

This information is not an image but rather a cloud of points that AVs make sense of using a technique known as "scene flow." Scene flow involves calculating the speed and trajectory of each 3D point, with groups of points moving together interpreted by the AV as moving objects such as vehicles and pedestrians.

以前,用于训练AV系统的最新方法需要使用大型标记的传感器数据集,这些数据已注释,这些数据随时间时间跟踪每个3D点。但是,标记每个数据集是一个耗时且昂贵的过程,因此,也许只有相对较少的数据存在。

结果,通常使用模拟数据进行场景流训练。即使对可用的少量现实数据进行了微调,这也是如此少得多。

Scene flow can be used to predict the future position of a cyclist by comparing the current LiDAR point cloud of a street scene, in green, with the point cloud from the previous time step in the sequence, shown in red. Image credited to卡内基·梅隆大学

采取不同的方法

相反,研究团队尝试了另一种方法。他们使用了未标记的数据,该数据相对容易生成丰富,以进行场景流训练。他们为系统检测其场景流误差开发了一种方法。

在每种情况下,系统都试图预测每个3D点的位置以及它移动的速度。以下实例测量了最接近预测位置的3D点的预测位置和实际位置之间的距离,这是第一种误差。

然后,系统逆转过程。从预测的点位置开始,它可以向后绘制回到点的起源位置。在这一点上,它测量了预测位置和实际起源点之间的距离,这是第二种误差。

然后,系统可以纠正这些错误。"It turns out that that to eliminate both of those errors, the system actually needs to learn to do the right thing, without ever being told what the right thing is,"CMU机器人学院的助理教授David Held说。

使用数据训练AV系统

为了证明他们的方法,研究人员使用一组合成数据(25%)计算了场景流的准确性。补充现实世界数据时,这仅增加到31%。但是,当他们添加大量未标记数据以使用其方法训练系统时,效率跃升至46%。

"Our method is much more robust than previous methods because we can train on much larger datasets,"研究实习生Himangi Mittal说。